El arrollador avance de la inteligencia artificial (IA) obligó a la Unión Europea a regular el desarrollo de estas tecnologías. La Ley de IA de la Unión Europea entró en vigor el 1 de agosto de 2024, siendo el primer reglamento exhaustivo sobre IA del mundo.

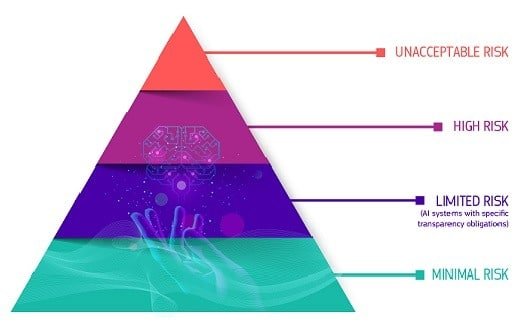

Con el objetivo de abordar los riesgos de seguridad que representa una tecnología cada vez más avanzada, la Ley de IA clasifica las aplicaciones de inteligentes en tres categorías de riesgo: riesgo inaceptable, aplicaciones de “alto riesgo” y sistemas de riesgo “mínimo”.

El marco jurídico, que comenzará a aplicarse en 2026, fue anunciado oficialmente por la presidenta de la Comisión Europea, Ursula von der Leyen, a través de su cuenta de X:

Today, the Artificial Intelligence Act comes into force.

— Ursula von der Leyen (@vonderleyen) August 1, 2024

Europe's pioneering framework for innovative and safe AI.

It will drive AI development that Europeans can trust.

And provide support to European SMEs and startups to bring cutting-edge AI solutions to market. pic.twitter.com/cRoVoRtEy0

(Podría interesarte: Optimus: así es el robot humanoide de Elon Musk que busca reemplazar el trabajo “aburrido”)

Los 3 niveles de riesgo que analizará la Ley de IA de la Unión Europea

La Ley de IA es el marco jurídico pionero de su tipo. Según el Future of Life Institute (FLI), organización independiente que trabaja para reducir los riesgos extremos a gran escala de las tecnologías transformadoras, las 3 categorías de riesgo que analizará la Ley de IA europea serán:

- Riesgo inaceptable: se prohibirán las aplicaciones y sistemas que supongan un riesgo inaceptable, como los sistemas de puntuación social gestionados por el gobierno, como los que se utilizan en China.

- Alto riesgo: las aplicaciones de alto riesgo, como una herramienta de escaneo de CV que clasifica a los solicitantes de empleo, estarán sujetas a requisitos legales específicos.

- Bajo riesgo: las aplicaciones que no están explícitamente prohibidas o catalogadas como de alto riesgo, quedarán en gran medida sin regular.

Ante esta regulación, cada aplicación de IA que quiera ingresar a la Unión Europea deberá cumplir con un requisito mínimo de seguridad con los usuarios. Ante cualquier irregularidad respecto a los derechos fundamentales de las personas, la IA será prohibida o regulada en los 27 Estados miembros de la UE.

(Leé más: Solo el 13% de los argentinos utiliza la Inteligencia Artificial en su trabajo, según estudio)

Ley de IA centrada en la seguridad de los usuarios

Ante el desarrollo abrupto de la inteligencia artificial, protagonizado por gigantes tecnológicos como Google, TikTok, Chat GPT y Tesla, la Unión Europea creó la Ley de IA pensando en la seguridad de los usuarios.

Según un análisis del Center for Data Innovation, la “Ley de IA de la UE costará 31.000 millones de euros en los próximos cinco años y reducirá las inversiones en IA en casi un 20%”. Aunque, otro estudio llevado a cabo por el empresario Meeri Haataja y la académica Joanna Bryson, concluyó en que la aplicación de la Ley de IA será mucho menos costosa ya que “el reglamento cubre sobre todo una pequeña proporción de aplicaciones de IA consideradas de alto riesgo.”

A fin de cuentas, la reciente Ley de IA que entrará en vigor de manera completa a partir de 2026, buscará aumentar la tranquilidad de los usuarios y evitar el robo masivo de información que ya ha ocurrido con plataformas como TikTok, que utilizan los datos del usuario para fines comerciales, principalmente.